Dans la course effrénée déclenchée par l’IA générative, il existe une réalité sous-jacente que de nombreux chercheurs commencent à observer dans le développement des modèles d’intelligence artificielle.

Roadshow Data & IA

Bordeaux 19 Mai 2026 09h00 – 14h00La philosophie antique converge à nouveau avec la science. Beaucoup ignorent que la philosophie et la science formaient autrefois un seul et même domaine de connaissance. Au fil du temps, les circonstances historiques ont séparé leurs chemins. Les philosophes de l’Antiquité observaient la nature et examinaient la réalité à travers la logique. Ils ont construit des cadres de pensée sophistiqués et formulé des hypothèses sur le monde d’une manière qu’il nous est difficile de saisir pleinement aujourd’hui, parvenant à des conclusions profondes par le seul raisonnement, sans agents ni Data.

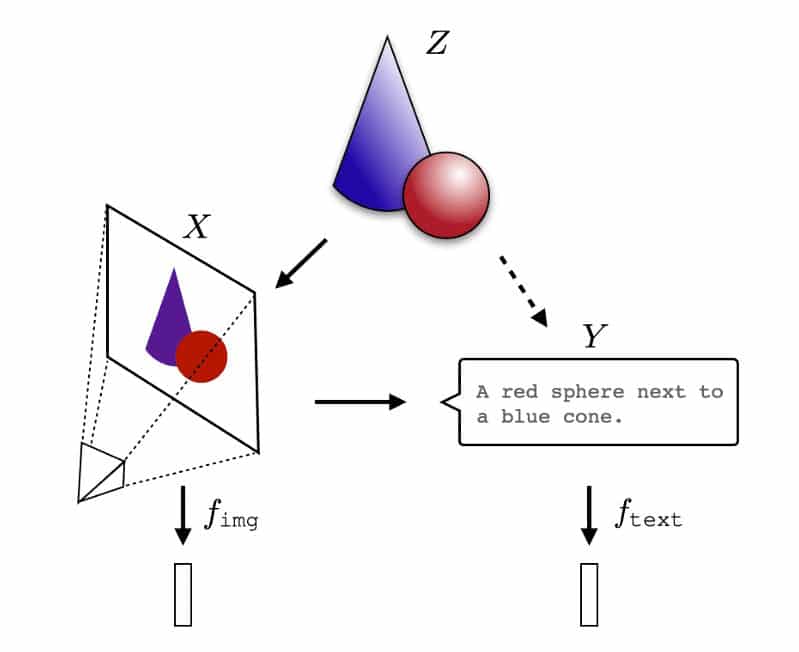

Représentation platonicienne et IA

Dans un article de 2024 intitulé « L’hypothèse de la représentation platonicienne », les chercheurs Huh, Cheung, Wang et Isola proposent quelque chose de remarquable : des modèles d’IA, même lorsqu’ils sont entraînés de manière complètement différente, avec des ensembles de données, des architectures et des objectifs différents, semblent converger vers la même représentation interne de la réalité.

Comprendre une idée fondamentale

Imaginez que vous demandiez à dix personnes de dessiner une carte de leur ville. Chaque personne utiliserait sa propre méthode et ses propres matériaux. Mais si chacun créait sa carte avec suffisamment de soin et de détails, les cartes qui en résulteraient finiraient par être équivalentes, car elles représentent toutes la même réalité sous-jacente.

C’est précisément ce qui semble se produire avec les modèles d’IA. À mesure que les modèles deviennent plus importants et plus puissants, ils convergent de plus en plus vers des représentations du monde très similaires.

Les chercheurs ont comparé des modèles de vision (entraînés exclusivement sur des images) avec des modèles de langage (entraînés exclusivement sur du texte) et analysé comment ils organisent l’information en interne. Le résultat était frappant : plus un modèle devient grand et performant, plus sa structure interne ressemble à celle d’autres modèles. Et ce, même s’ils ont été entraînés sur des ensembles de données complètement différents et utilisent des architectures différentes également.

Par exemple, un modèle entraîné uniquement sur du texte développe une représentation interne de la couleur qui est remarquablement similaire à la représentation apprise par un modèle entraîné uniquement sur des images. Les modèles n’ont jamais « communiqué », mais ils sont parvenus à des conclusions structurellement équivalentes.

Les chercheurs avancent plusieurs explications possibles. L’une des idées principales est que lorsque les modèles doivent être performants dans de nombreuses tâches, ils ont tendance à converger vers les mêmes solutions optimales que leurs homologues. Les réseaux de neurones présentent également un biais naturel vers la simplicité. De par leur nature mathématique, ils ont tendance à découvrir la solution la plus simple possible, et cette solution reflète souvent la structure sous-jacente du monde lui-même.

C’est là que la philosophie fait son entrée ! La représentation platonicienne fait écho à l’allégorie de la caverne de Platon. Les images et le texte utilisés pour entraîner les modèles sont comme des ombres projetées par la réalité. Les modèles apprennent de ces ombres, c’est-à-dire des données, et parviennent progressivement à saisir la structure profonde qui sous-tend la réalité.

Platon, Aristote et la perspective quantique

Platon distinguait deux niveaux de réalité. Les Formes (ou idées) sont parfaites, éternelles et immuables. Ce que nous percevons à travers nos sens ne sont que des copies imparfaites de ces Formes. L’allégorie de la caverne illustre ceci : les humains ne voient que des ombres projetées sur un mur, jamais la réalité elle-même.

Ce que l’article suggère, c’est que les modèles d’IA, qui sont entraînés sur des millions de ces « ombres » sous forme d’images, de textes et de sons, peuvent être algorithmiquement capables de restituer quelque chose de similaire aux Formes : une structure profonde et commune sous-jacente à tous les phénomènes observables.

Il existe cependant une distinction philosophique importante. Pour Platon, les formes sont ontologiquement primaires : elles existent indépendamment de tout esprit ou perception. Ainsi, la chaise parfaite existe, que quelqu’un y pense ou non.

L’hypothèse avancée dans l’article est plus modeste et plus scientifique. La représentation platonicienne est essentiellement une structure statistique : un modèle probabiliste décrivant comment les événements sont répartis dans le monde. Il ne s’agit pas de pure métaphysique, mais de mathématiques. Cette perspective s’inscrit davantage dans le réalisme scientifique que dans la pensée platonicienne stricte, avec l’idée selon laquelle la science converge progressivement vers des descriptions de plus en plus précises de la réalité.

Aristote a critiqué Platon précisément pour avoir séparé les Formes des choses concrètes. Pour Aristote, la forme d’un chien n’existe pas dans un monde à part. Elle existe au sein même du chien, dans sa structure et son organisation.

En ce sens, les modèles de l’IA semblent plus proches de la conception d’Aristote. Ils n’apprennent pas du domaine abstrait des idées, mais de la structure inhérente aux données concrètes. La représentation émerge de bas en haut, à partir des copies plutôt que de descendre de l’idéal.

Cela nous rappelle aussi Kant et la limite irréductible : nous ne pouvons pas accéder au monde tel qu’il est en soi. Nous n’accédons au monde que tel qu’il apparaît à travers les filtres de notre structure cognitive, de notre biologie et de nos systèmes sensoriels. Toute la science est construite sur ces biais sensoriels.

Les modèles d’IA héritent de ces biais parce qu’ils apprennent à partir des données produites dans les limites de la perception humaine. La synthèse qui en résulte peut être extrêmement puissante, mais elle peut aussi présenter les mêmes limites structurelles, voire les amplifier.

On peut noter un autre rebondissement : suivre cette ligne de pensée conduit finalement à des concepts comme le conditionnement circulaire, la théorie quantique et le fait que la réalité ne peut être interprétée sans un cadre préalable, mais ce cadre lui-même est construit à partir d’interprétations antérieures.

Nous ne touchons jamais directement la réalité sous-jacente. Nous n’interagissons qu’avec les sensations qu’elle procure. C’est le cercle herméneutique. Si nous suivons cette logique, le sujet qui observe modifie l’objet et l’objet modifie le sujet lorsqu’il est observé.

Le système qui modélise la réalité fait lui-même partie de la réalité qu’il modèle.

La « représentation platonicienne », ou ce que l’on pourrait appeler une « représentation aristotélicienne », vers laquelle convergent les modèles d’IA ne décrit peut-être pas la réalité vue de l’extérieur. Elle reflète peut-être davantage la meilleure description que la réalité puisse donner d’elle-même de l’intérieur.

Au-delà des silos scientifiques

Pour progresser et englober la réalité, la science s’est de plus en plus spécialisée. La connaissance était divisée en domaines hautement techniques qui ont permis à l’humanité, compte tenu du contexte historique, de faire des progrès extraordinaires. Des figures comme Aristote ou Léonard de Vinci pouvaient couvrir plusieurs domaines, mais les progrès scientifiques modernes ont rendu cette polyvalence impossible.

La savoir s’est ainsi divisé en disciplines : physique, chimie, biologie, psychologie, économie et philosophie. Chaque discipline a développé son propre langage, ses méthodes, ses revues et ses conférences. Le prix à payer a été important. Des problèmes qui, par nature, forment un tout ont été fragmentés en domaines distincts qui communiquent rarement entre eux. La conscience, par exemple, relève à la fois des neurosciences, de la physique, de la philosophie et de l’informatique, mais chaque domaine l’étudie en grande partie de manière isolée.

L’intelligence artificielle a le potentiel de changer la donne. Si les modèles d’IA représentent des structures de connaissances unifiées, ces silos pourraient commencer à disparaître. Nous pourrions être capables de relier des domaines de connaissance et de détecter des modèles d’une manière qui serait autrement impossible. Non pas parce que les humains manquent d’intelligence, mais parce que l’IA n’est pas confrontée aux mêmes obstacles institutionnels, cognitifs et biologiques que nous.

On l’observe déjà à une échelle modeste mais significative. Par exemple, AlphaFold, un système d’intelligence artificielle de pointe développé par DeepMind, a établi des liens entre la physique, la chimie et la biologie comme aucun spécialiste n’avait réussi à le faire auparavant. Les grands modèles de langage (LLM) mettent en lumière des liens entre des articles scientifiques de différents domaines qui, pendant des décennies, ne se citaient pas mutuellement. Les avancées dans ce sens, notamment chez Google DeepMind, sont particulièrement remarquables.

Il y a quelque chose de mélancolique dans cette prise de conscience. Plusieurs traditions intellectuelles ont tenté d’atteindre précisément cet objectif et ont finalement été marginalisées : les érudits polyvalents de la Renaissance ; la naturphilosophie allemande, qui aspirait à une science unifiée, le projet de l’Encyclopédie de Diderot, le structuralisme du XXe siècle, qui recherchait des modèles communs à la linguistique, l’anthropologie et la psychologie, et la vision de Leibniz d’un langage universel de la pensée.

Toutes ces tentatives ont échoué, en partie parce que les outils nécessaires n’existaient pas. Le nombre de connexions possibles entre les domaines dépasse de loin les capacités cognitives humaines. Peut-être étaient-elles simplement en avance sur leur temps.

Une question ouverte pour l’IA et la philosophie

Y a-t-il une seule réalité sous-jacente, ou plusieurs ? L’une est-elle plus réelle que les autres ?

Ce ne sont pas là des questions rhétoriques. Elles pourraient bien devenir le prochain défi majeur tant pour la philosophie que pour la recherche sur l’IA. La convergence des modèles suggère qu’une structure unifiée pourrait exister. Cependant, si nos données sont façonnées par notre biologie, dans quelle mesure cette convergence reflète-t-elle la réalité et dans quelle mesure reflète-t-elle également la projection de notre propre structure sur le monde ? Les données synthétiques pourraient-elles refaçonner cette représentation ?

L’IA pourrait-elle finir par dépasser notre représentation de la réalité et en construire une qui lui soit propre ?

Un période extraordinaire à vivre

Ce qui rend ce moment véritablement remarquable, c’est que des idées qui sont restées des spéculations philosophiques pendant des siècles deviennent aujourd’hui des hypothèses vérifiables empiriquement. Et les premiers éléments suggèrent que quelque chose de ce genre pourrait bien exister.

L’IA ne résout pas le problème philosophique. Mais pour la première fois, elle fournit un outil opérant à l’échelle nécessaire pour s’y attaquer sérieusement, non pas en tant que métaphysique spéculative, mais comme programme de recherche empirique et mathématique.

La spécialisation nous a permis d’avancer rapidement en décomposant les connaissances en parties gérables. L’intégration, rendue désormais potentiellement possible par l’IA, pourrait nous permettre de reconnecter ces parties et de révéler la structure plus profonde qui les a toujours reliées.

Relier les points, c’est ce que l’humanité a toujours cherché à faire. La différence, c’est que nous pourrions enfin disposer d’un outil capable de faire face à l’ampleur du problème.

👉 Retrouvez toute notre actu en temps réel en nous suivant sur LinkedIn

Commentaire (0)

Votre adresse de messagerie est uniquement utilisée par Orange Business, responsable de traitement, aux fins de traitement de votre demande et d’envoi de toute communication de Orange Business en relation avec votre demande uniquement. En savoir plus sur la gestion de vos données et vos droits.